t2のTwitterイラスト検索結果。 6,677 件中 52ページ目

....99% for @LofiWiseman but t2members will also get an uncropped version of this.

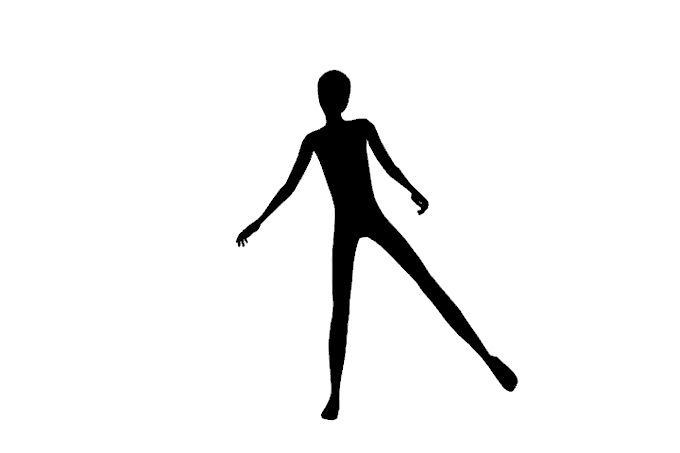

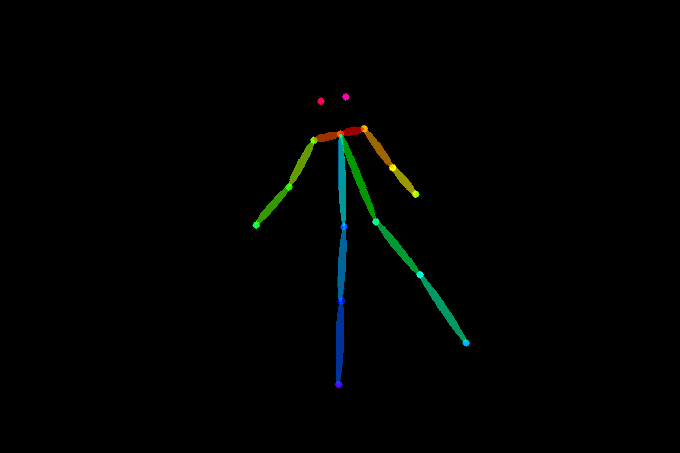

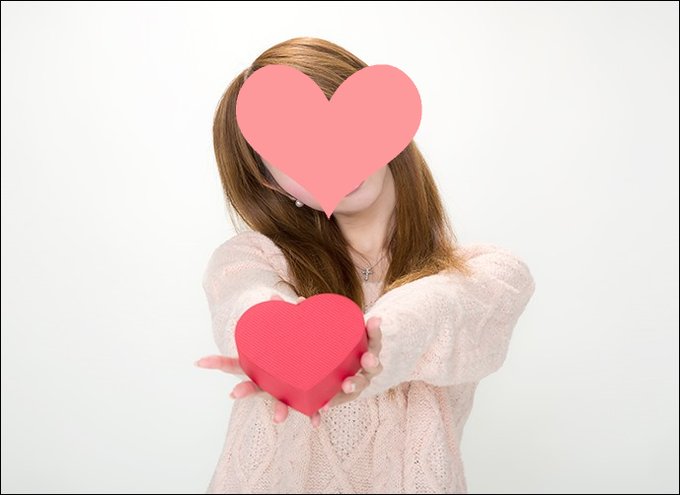

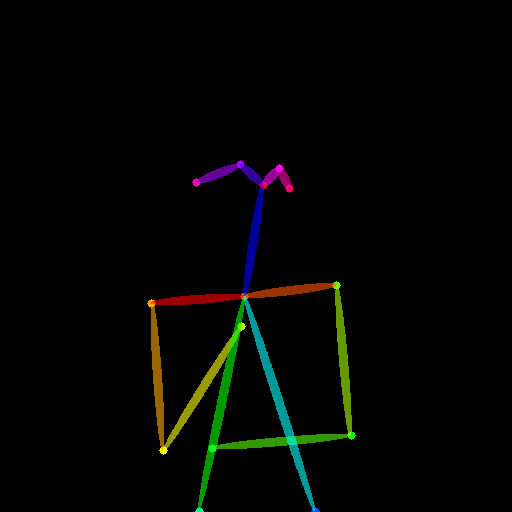

これ(1枚目)をこう(ControlNet t2i、2枚目)して、こう(i2i、3枚目)じゃ!

ハッピーバレンタイン!

#AIart

WD1.5_e1+LoRA

t2i->upscale

#AIart #StableDiffusion #WaifuDiffusion #Dreambooth

@clock_luna 解説ありがとうございました。

無事実験が成功しました。

1枚目:MMDによる素体モデルのポージング

2枚目:opnepose画像

3枚目:t2iによる画像生成

4枚目:i2iで高画質化

ちょっと不思議なポージングも十分行けそうです。

ControlNetの自動着色に指定AIモデルを使えるようになったので検証3。

線画着色検証。

1枚目 指示絵(nijijourney t2i)

2枚目 AI強め

3枚目 バランス

4枚目 グレスケ漫画風

ControlNetのCanny。

ControlNetの自動着色に指定AIモデルを使えるようになったので検証2。

グレスケ絵だけでなく、線画からも着色できる。凄い。

1枚目 指示絵(nijijourney t2i)

2.3.4枚目ControlNetのCanny。

【マリン船長】それぞれ違ったところで

#ホロライブ

#マリンの宝

#Aiアート

#デジタルイラスト

引用元含めて、Aiアートなので取り扱い注意で、(いうて全て一発で決めたt2i)ダグも付いてるし三段構えでオナシャス

いや、だってほら、バレンタインじゃん? https://t.co/k0nEHuofHY

WebUIのSD-WebUI-ControlNetについて

・どんなもの?

元画像からボーンや輪郭を認識し、それらを参照してt2iで出力できる

・どんな時に使う?

実写や(AI)イラストなどから、似た構図を出力したい時

今回は1枚目→2枚目にする工程を解説します(リプに続きます

#automatic1111 #AIイラスト #AIart

SD-WebUI-ControlNetのお試し

とりあえずPreprocessorとモデルはopenposeを指定しました

ちなみにt2iでポーズ指定は一切してません

1枚目 :参照元画像

2枚目 :1枚目を元にinputされた画像

3・4枚目:実際に生成出来た画像

#automatic1111 #AIイラスト #AIart