WebuiのTwitterイラスト検索結果。 473 件中 16ページ目

#stablediffusion v2.1

呪文はaltに記載。

そういえばautomatic1111さんのwebui、呪文のトークン上限がなくなっているわけですが、どうも色々試していると75トークン超えるとかなり不安定になる感じがしました。SD2.x系だけかもですけど。

この辺はちょっと今後の動向を気にしておくかなぁ。

Then I took that #dalle2 output and brought into #stablediffusion AUTOMATTIC1111 local WEBUI. (i also downloaded the ckpt file from strmr and loaded into models folder for the webui).

There I ran stylepile on it, using the trained ckpt to give it a cohesive style. And Viola! 4/4

自分なりの画像分類のやり方を紹介する。

画像生成AIで大量に生成したAI画像を管理するやり方【Stable Diffusion WebUI(Automatic1111版) / #AIart】 – 忘却まとめ

https://t.co/uXDY3GXLG1

#NovelAI #NovelAIdiffusion #AIart

その黒いメカは9年もの間、待ち続けていた。アーマード・コアと名付けられたそのメカは、一度敗れ去ったものの、いつかまた必ず蘇ると言われ、待ち続けていた。突然、何の前触れもなく、その日はやってきた。

(NovelAIで生成→WebUIでサイズアップ)

@8co28 852話さんが作った 8528-diffusion-v0.2をGoogle Colab上で起動したWebUIで使用するコードです。

https://t.co/slD5EtZwIZ

Running on public URL: https://t.co/59uk61Jg19

と出てくるURLをブラウザの https://t.co/kbnG05BECF のURLを別ウインドウで開くと、AUTOMATIC1111が動きます!

#8528d

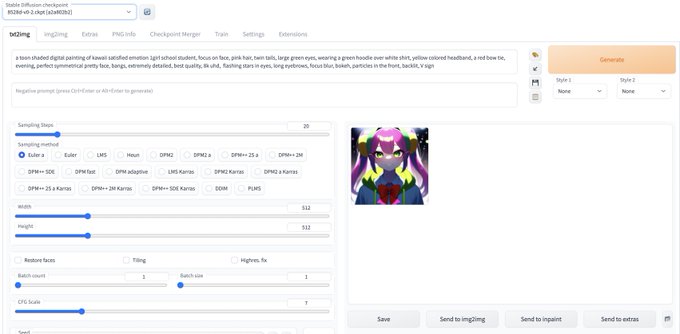

#stablediffusion v2.1

stable diffusionの2.1が公開されていたのでさっそく!

普通にautomatic1111さんのwebuiに導入できますね!

新しいモデルを試すときは最初絵画調のフレーズから始めて(①②)だんだんアニメっぽいテイストに寄せて行ったり(③④)してますです!

よ、ようやくwebUIが実用レベルになって来た……(´;ω;`)ブワッ

これであっしも憧れのカスタムモデルですよ奥さん

#invokeai #EimisAnime #EimisAnimediffusion #AIArtwork #aiartcommunity #aiart #AiArtSociety #AIartists #digitalart #digitalartwork #AIイラスト #AI術師さんと繋がりたい

#MajinAI いいね🥰

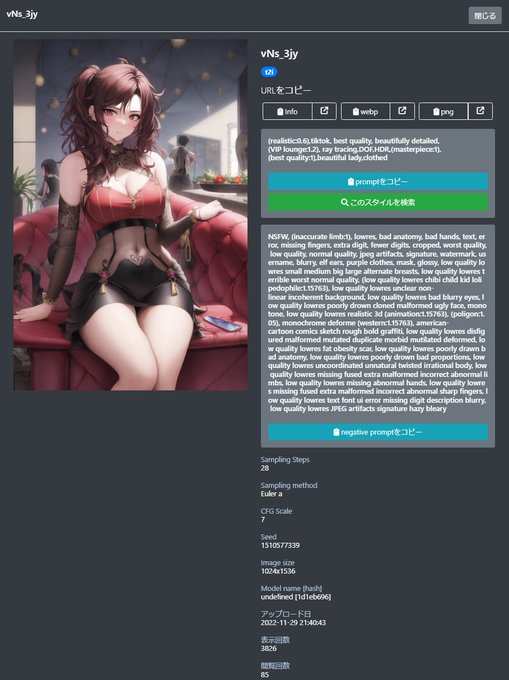

不特定多数にAIイラストを投稿できるサイトw

https://t.co/i1SoOPBawN

まだ投稿数多くないけど、呪文も検索できる!

皆上手くて参考なる👩🎓

投稿欄に呪文入れる欄無いのにpromptがアップされてるので、NovelAIやwebuiの生成結果で画像に呪文とか埋め込まれてるやつ前提なのかな?

#StableDiffusion #anythingv3 #AIイラスト #AI絵 #AIart

#結月ゆかり

DAAM

昨日、WebUIを最新に更新してもダメだったので諦めてたのだけど、

大手様方の会話をのぞき見しててWebUIを最新にすれば入れられたという話を聞いて、

丸ごと削除してインストールし直したらいけた。

元素法典2.5:蘑菇森林法v1.5

です。

NovelAI本家用に変換したプロンプトも載せてます。

step数かけた方がいいやつなので、webUI(ローカル)向けって感覚ですね・・・

(1/3)

#safetensors の変換→webuiで読込に成功♪

T4でload10数秒と少し早い

生成は同一!

【WDの変換例】

import torch

from safetensors.torch import save_file

weights = torch.load("wd-v1-3-float16.ckpt")["state_dict"]

save_file(weights, "wd-v1-3-float16.safetensors")

https://t.co/VUTLTRabrn

@kohya_ss またお借りしてます。

無料Colabでも768でDreamBoothが動きました!

そのあとWebUIでckptを読み込んで画像生成まで確認できました。

https://t.co/plDqK8CTWb

ViT-L/14@336px でCLIP反映能力UPしたのか呪文の効きが良くなった気するます

インストールしたwebuiの

modules/sd_hijack.py の83-90行目を

なんか先生のコードに差し替えるだけ👩🍳

#Elysium も問題なく動作(モデル不問)

サキュバス店員、異世界BBQ屋へ出張勤務

#いい肉の日

https://t.co/eE2indMKUQ

StableDiffusion2.0検証のためautomatic1111 WebUIを更新して以降、なぜかi2i重ね掛けしても濃度が上がらない問題発生中。multicoloredも動いていない気がします #WaifuDiffusion #AIイラスト