CNのTwitterイラスト検索結果。 9,509 件中 5ページ目

結論から言うとやっぱりControlnetで色の制御はできないっぽいですね!!!!

かたらぎさんに依頼していたブラーCNですが、グレスケ入力してもカラー入力しても、ほぼ同じ結果になりました!

むしろグレスケの方がなんかいい感じかも、なぜだ・・・・!!!

まって、昨日のやつ(anytest_v4-marged)Comfyでワークフロー作ってやったら精度全然違うんだけど…

A1111の方のやり方まちがってたのかな?

指できてるにゃ🐈️

そういえばリンク。

やり方はこれをCNのモデルに指定してプリプロセッサは何も入れないだけ。

https://t.co/52EcJTfavM

#AIイラスト

極力色合い変えずにAIに書き込みさせるLoRA公開しました!!!

https://t.co/u91nYmBw5P

i2iでデノイズ0.45-0.5。

CN-anytest_v3-50000_am_dim256 [dbecc0f9]:1.0

Katarag_lineartXL-fp16 [ac23a680]:0.25

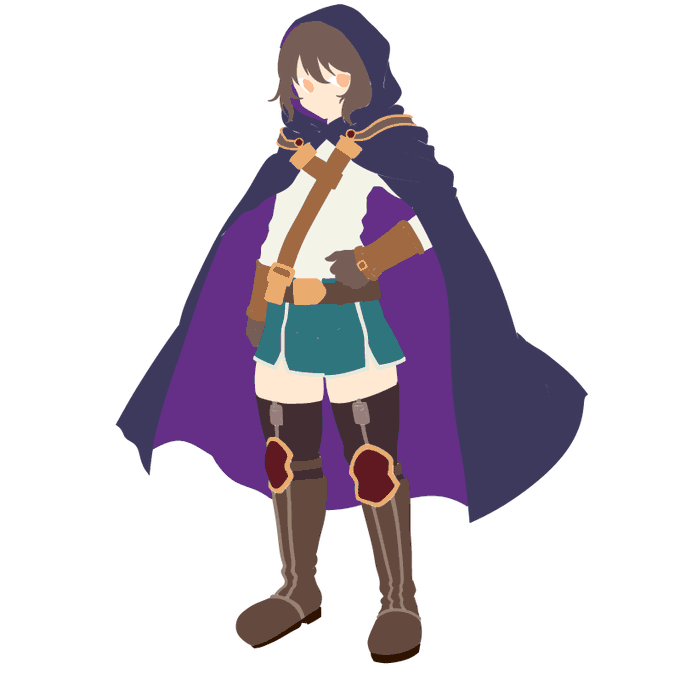

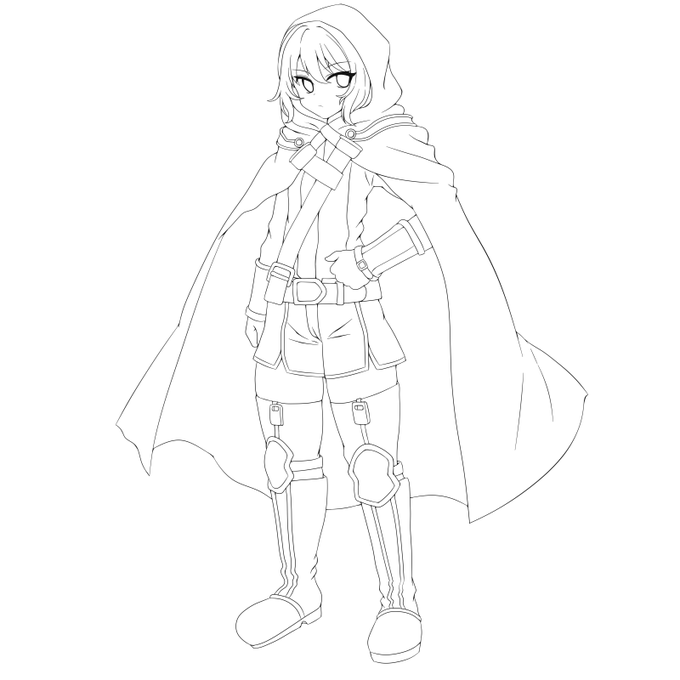

バケツ塗り絵をi2iに。線画をCN二つにぶち込む感じです。

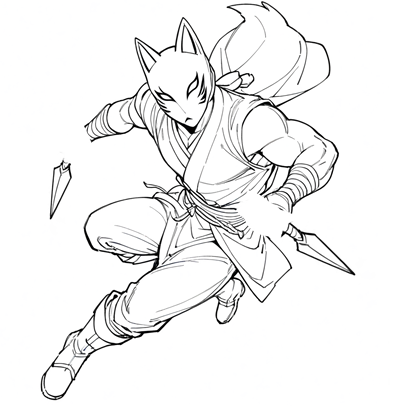

anytest_v4試してた。

再現性という意味ではめちゃくちゃ良いというわけでもないけどプリプロセッサ考えずに雑に描いたやつそのままいけるのは楽にゃ🐈️

リアルタイム用CNとしていいのでは?

1:手描き元絵

2:anytest_v4-marged_pn_dim256

3:diffusers_xl_canny

4:xinsir_anime-painter-scribble

@nana_tsukisuwa 昨日こちらを学習させたところやはり色あいの制御はCNには難しいという結論になりました。

https://t.co/B6LItcYDnf

ので、開き直ってセグメント分けに利用するランダムバケツ塗色配置LoRAとか作れないかなと考えています。

ご意見いただけると助かります・・・!

SD1.5で生成していた画像をCN Kataragi_inpaintXLでリメイク

プリプロセッサを空欄のまま使用すると1.5のtileのような感じになりました

also CN/HK/TW comic being stereotyped as having "clean cultivation light novel/ bishie drama danmei art style" too

even though someone had a ikegami brainrot back then in the 90s (and one even love yasuhiko too much lol)

sad that it's quickly forgotten tho ☠️

ふとこちらを利用して、3D陰影のスタイル変換ができないか検証したところあっさりできました!

専用のCN作ろうと思っていたけどこれで済むならヨシ!! https://t.co/H1eQfYOGWX