diffusersって2系のtext encoderは最終層が既に切除されてて、自動的にclip skip=2になっていると考えていいんだよね?

このissueは読んだ

https://t.co/YhX7f0fjBG

というか、wd15はほとんどclip skipの違いが出ないのか?

1: clip skip = 1

2: clip skip = 10

むー、dedede pipelineのunetとvaeをControlNetPipelineに入れてみたんだけど、なんか品質が低い。

やってることはMikubillさんの実装と同じはずなんだけど...

よくわからんから一旦棚に上げるぜ!

昔作った手描きのアニメーションにControlNetのscribble2imgで着色してみた。

モデルはdedede

頑張れば頑張れそう!

ControlNetのscribble2imgで、scribbleとして渡す線画とは別に、下塗り済みの絵を初期ノイズとしてimg2imgに渡すと、線画を守らせたまま色もコントロールできることが分かった。

いいっすね

一枚目: 線画

二枚目: 下塗り

三枚目: 通常のs2i

四枚目: s2i + i2i

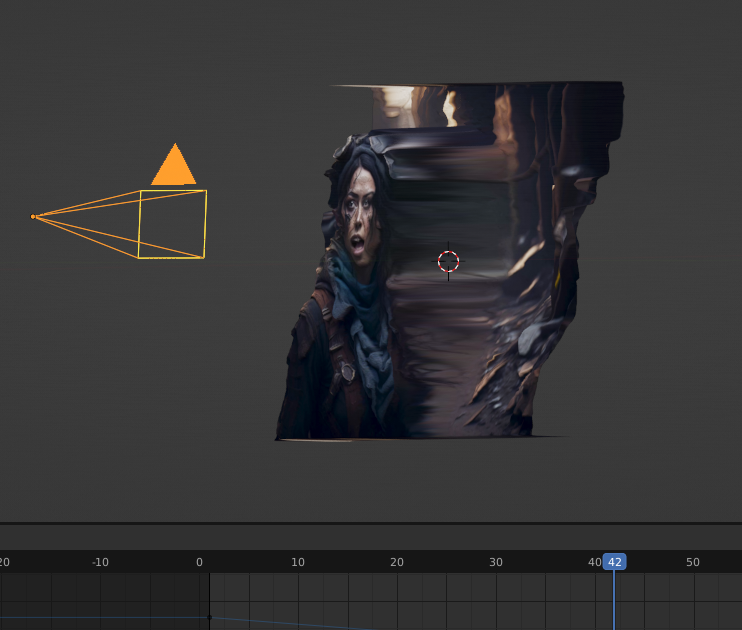

スパファ口パクgifでチューンしたTAVモデルでv2vしたらいい感じになった

やはり、特定の動画で過学習させる方向ではなく、時間に対する一般的な知識を身に着けてもらうほうが良さそう

過学習させると絵柄の幅がほぼゼロになってしまい、やりたいことが出来ない

More-Shotの学習コード書くぜ!

手始めに、Instruct Pix2Pixでimg2imgできるようにしてみた。

一応期待通りに動いてるみたい。ただ、何に使えるのかは不明。

https://t.co/eb81da93jq

prompt = put a pearl earring on her

一枚目: instruct image

二枚目: init image

三枚目: strength 1.0

四枚目: strength 0.5