ControlnetのTwitterイラスト検索結果。 1,058 件中 53ページ目

Latent Couple、どうにか今の絵柄の範囲内に寄せてhires2倍に耐えれたので寝る!

今日も有意義だったしがんばったあ💯

まだControlnetは手付かずだし楽しみ💜

明日も明後日も明々後日も楽しみだよ

Good night晩安おやすみみ🌟

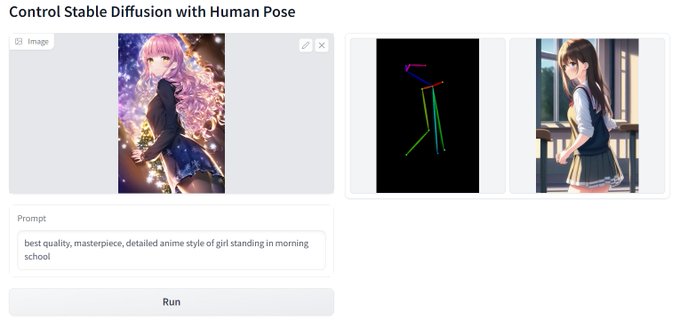

WebUIのSD-WebUI-ControlNetについて

・どんなもの?

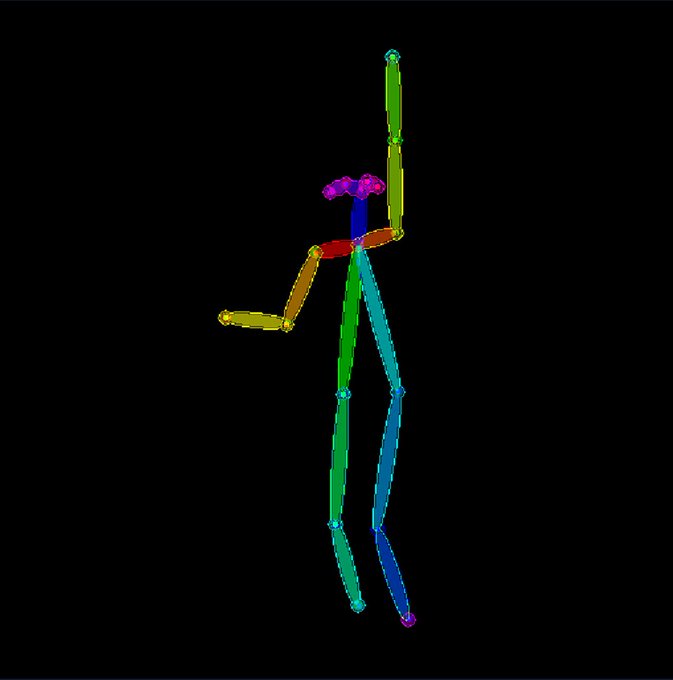

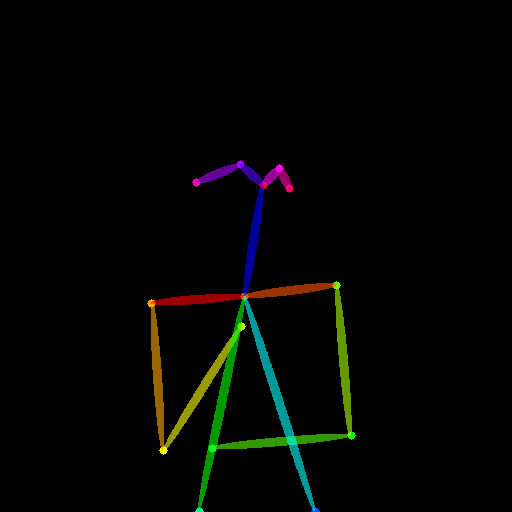

元画像からボーンや輪郭を認識し、それらを参照してt2iで出力できる

・どんな時に使う?

実写や(AI)イラストなどから、似た構図を出力したい時

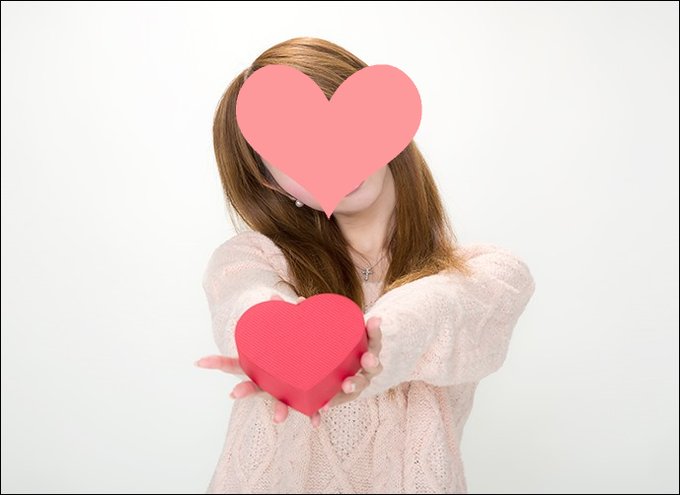

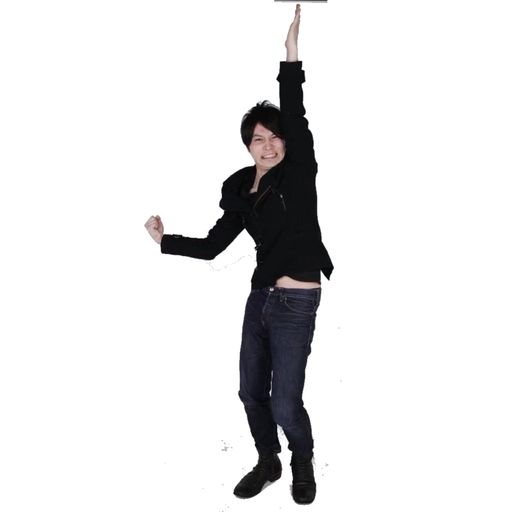

今回は1枚目→2枚目にする工程を解説します(リプに続きます

#automatic1111 #AIイラスト #AIart

SD-WebUI-ControlNetのお試し

とりあえずPreprocessorとモデルはopenposeを指定しました

ちなみにt2iでポーズ指定は一切してません

1枚目 :参照元画像

2枚目 :1枚目を元にinputされた画像

3・4枚目:実際に生成出来た画像

#automatic1111 #AIイラスト #AIart

LoRAによるControlNet、できた~(・∀・) 1枚目controlなし(i2iもなく普通に生成)、2枚目あり。

公式のCanny EdgeのControlNetとSD1.5の差分をrank 128のLoRAとして抽出してACertaintyに適用、input_hint_blockとzero_convはそのまま使用。

ただかなり効果が弱いので微妙……。

https://t.co/5zJVTki4a4

古町ちゃんと団五郎くんの塗り絵をDeDeDeとControlNet Scribblesで塗ってみました(個人使用の範囲になると判断しています)

目を開いたり「そこは雲では」みたいなのは思わなくはないですが、個人的にはまあ見てて面白い #AIArt

ControlNet、軽く試したら、大分二次元よりでも体勢を拾ってくれるので、Diffusion ModelのほうをまるっとDeDeDeに入れ替えてみたら普通に動いてびっくりしちゃった

塗りのほうは試してないけど似たように入れ替えるだけでどうにかなるかもしれない #AIArt

入力画像を変換するタスクを Diffusion モデルで解く ControlNet についての解説記事を書きました。画像のような線画 -> 着彩のタスク等を解くことができます。

新時代の pix2pix? ControlNet 解説|まっくす https://t.co/IcN6wWHS6y #zenn

AI

ControlNet のwith User Scribbles使ってみた

人線画に着色をする

1枚目→2.3.4枚目

ある程度線が太くないと反応しない

既存のi2iより線の雰囲気残しつつ着色できて凄い。

ControlNet with Anime Line Drawingはアニメモデルだけどいろいろあってまだ公開できないらしい

AI ControlNet の with HED Boundary を使ってみた。

1枚目のモノクロを2.3枚目に着色出力

4枚目はグリザイユ的に1枚目にオーバーレイで乗せたもの

SDモデル準拠なのでこれをアニメ系モデルでできるようになったらすごそう。(これはアニメ系絵着色に向いたものではない)