controlnetのTwitterイラスト検索結果。 1,175 件中 54ページ目

どうすんだよ、これ

まだ学習モデル練ってる最中だから

初期のイケてない、マージ済み学習モデルに描画させたから可愛く無いけどさぁ

ポーズ、どうとでもなるぞ…

※しかも今の学習モデルならもっと綺麗に描画する…はず

#stablediffusion #AIイラスト #AIart #ControlNet

Trying out the ControlNet scribble model with some drawings #AIArt

#StableDiffusion2 / #StableDiffusion #DreamStudio

ControlNet試してみた。言語化しようのないポーズを取らせるには革命的かもしれない。デメリットとしてはプロンプトを使ってのアングル調整等をほぼ受け付けないことと、手の破綻がより顕著に現れる気がする。3Dでアングルとポーズを完璧に決めてから利用するのがいいかも?

昔作った手描きのアニメーションにControlNetのscribble2imgで着色してみた。

モデルはdedede

頑張れば頑張れそう!

記念すべきお嬢イラスト100枚目!

SDフル活用お絵かき。

ポーズ人形をもとにControlNet使用したSDで下絵を描く(2枚目:(モデルはCounterfeit-V2.0 と wd1.3 ))

そこから先、線画は完全に手描き。色塗りは少しだけSD。要するに実態はほぼ手描き

#stablediffusion

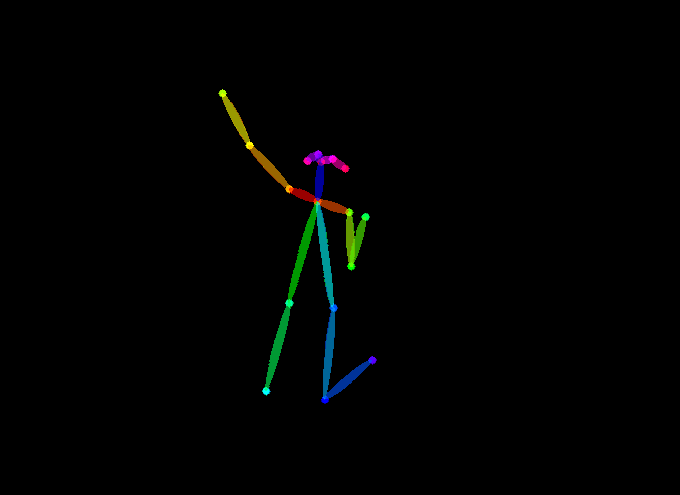

Cloabでも無事ControlNet(ミクビル版)を導入できました~お試しに大昔に生成した子から棒人間(openpose)を……

---

git cloneにてInstall from URLを、

wgetにてモデルをぶち込むのがミソでした

AIイラスト

ControlNetのscribble2imgで、scribbleとして渡す線画とは別に、下塗り済みの絵を初期ノイズとしてimg2imgに渡すと、線画を守らせたまま色もコントロールできることが分かった。

いいっすね

一枚目: 線画

二枚目: 下塗り

三枚目: 通常のs2i

四枚目: s2i + i2i

「……ないしょ」

ControlNetいいなあ、これの破綻率が大分下がった

Highres fix.とか生成画像サイズ大きくすると破綻するのを解決できた人は教えてください

#AIイラスト

あ、あれっ

SD-WebUI-ControlNetがさらっとi2iでも使えるようになってる?!

1枚目:i2iでの画面

2枚目:参照画像の棒人間くん

3枚目:i2i元

4枚目:i2i後

あたしが昔描いたエリカちゃんを

ControlNetがエッジ検出で線画化して、他のキャラにしてくれる

ラフ画をそのまま着色・服のシワとかシミュレートできる夢の機能だな