WebuiのTwitterイラスト検索結果。 466 件中 10ページ目

やはりi2iで画像読み込ませる時の挙動がおかしい(D&Dの後、一度クリックが必要) WebUIのデフォルト設定が変わったのかWin11の挙動が原因…? #WaifuDiffusion #AIイラスト

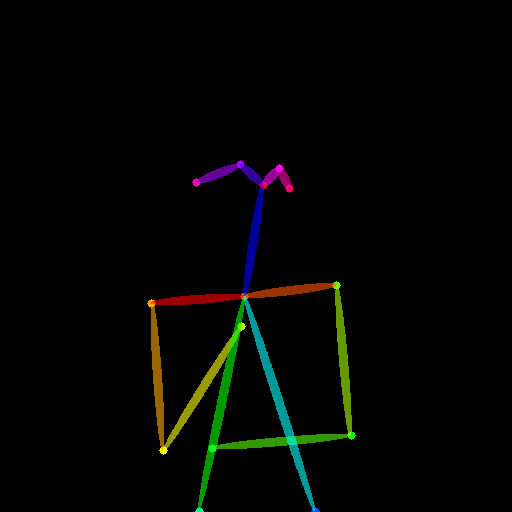

sd webui controlnetのポーズの拡張機能、適当に使ってみた。入力画像がしっかりポーズとして認識されるのがムズいのと、出力画像があまり綺麗ではない。軽く触っただけだし、今後改善されていくとは思うけど。もう寝ます😴 #stablediffusion #AIart #aiイラスト

するとある程度参照元画像と似たような構図が出てくると思います

また、認識されたものの画像(2枚目)も一緒に出てきますがこちらは自動的に保存「されません」

※WebUIの設定も確認しましたが保存するような項目は見当たりませんでした

WebUIのSD-WebUI-ControlNetについて

・どんなもの?

元画像からボーンや輪郭を認識し、それらを参照してt2iで出力できる

・どんな時に使う?

実写や(AI)イラストなどから、似た構図を出力したい時

今回は1枚目→2枚目にする工程を解説します(リプに続きます

#automatic1111 #AIイラスト #AIart

SD-WebUI-ControlNetのお試し

とりあえずPreprocessorとモデルはopenposeを指定しました

ちなみにt2iでポーズ指定は一切してません

1枚目 :参照元画像

2枚目 :1枚目を元にinputされた画像

3・4枚目:実際に生成出来た画像

#automatic1111 #AIイラスト #AIart

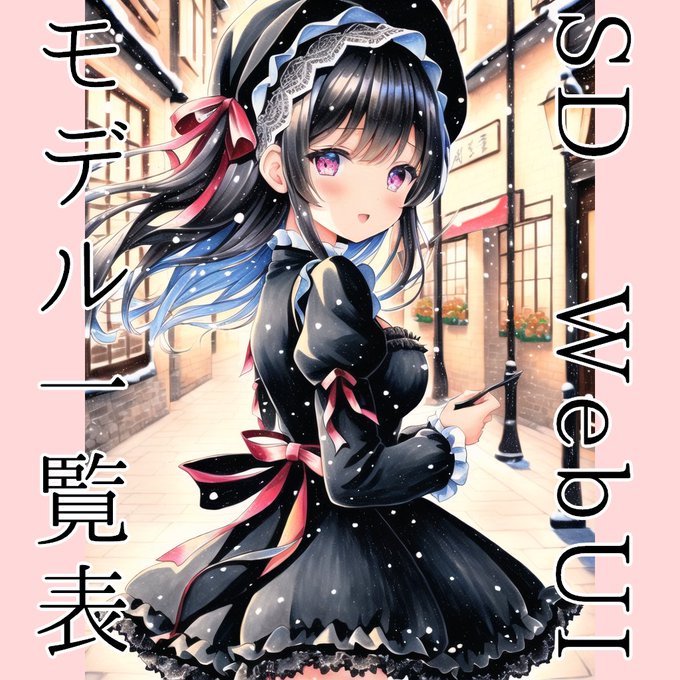

【特報】

お待たせしました!

SDWebUIの暫定モデル一覧表をリリースします!

56の主要・最新モデルを掲載した111ページに及ぶモデルカタログです!

毎日大量に発表されるモデルを追いきれないのでいったんここでリリースさせていただきます!

↓こちらから見れますどうぞ!

https://t.co/wSnN2ogVch

ローカルにwebUI(1111)環境を入れれて、ようやくローカルでこちょこちょ遊べるようになった!

うちのこあんずちゃんのアークなナイツ感あるサイパン戦士風!🙌✨

stable-diffusion-webui-two-shotが可能性の獣すぎる!

プロンプトの記載が独特になるから研究の余地はあるけど、今までの私の苦労はなんだったのかというぐらいにペアイラストが出来る!!

#AIArt

https://t.co/LU1f1XTy6b

Those who play with fire gets burned #webuilding #nftproject @theluckyllamas

Discord https://t.co/0H1EPCc33m

正解!このWebui拡張機能でカップルが作れる!

(*ローカルでの改造必要)

#AIArt #AIArtwork #AIイラスト #StableDiffusion #DefmixV1

精密画CFGスケール別hires fix2倍耐久テスト

1枚目:いつも使ってる5(開幕でねこみみ死亡

2枚目:WebUIのデフォルト7(ねこみみ生存

3枚目:NovelAIのデフォルト11(すごい強そう!

4枚目:絵としてどうにか耐えた2(全体的にすぐ死にそうだけどすき

#webbyvanderquack #ducktalesfanart #ducktales #stableDiffusion #AIArtwork

I made Webby Vanderquack AiArts with webUI! You can download LoRa File in huggingface (Just search Webby_Vanderquack)

「WebUIには〝hires.fix〟というi2iしてくれるUpscalerがある」という情報だけをヒントに、同じことをNMKDで再現しようとするテスト。

①t2iで作った画像

②これ(↑)を元にサイズを倍にしてi2i。

③Initiallization Image Strength 0.9

④Initiallization Image Strength 0.1

#AIart #StableDiffusiton

ルイズコピペの英訳をwebuiにつっこんだ

萌絵を生成しうることが判明しましたw

クンカクンカが、sniff sniffという無駄知識もふえた

ドット化が刺さる絵柄だったので。 (AI-generated / pixel-art converted by "stable-diffusion-webui-pixelization")