controlnetのTwitterイラスト検索結果。 1,175 件中 13ページ目

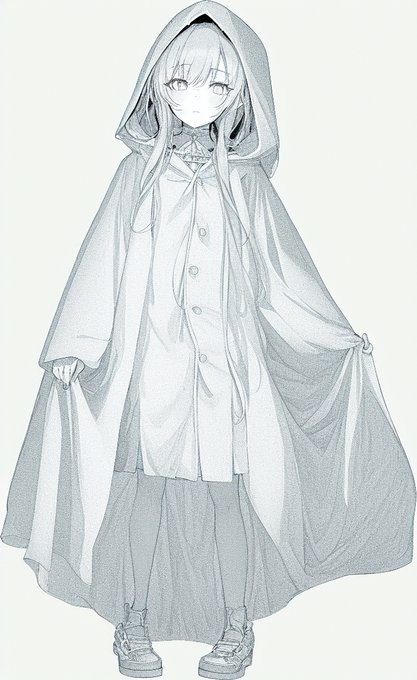

Gothic ladies (Line art + pastel. Auto1111 + ControlNet + Upscale) - by Bra2ha #AiArt #AiiA #AiArtCommunity #AiArtSociety #AiLust

Attention Couple+領域別LoRA、領域の境を64で割り切れる値にするときれいに分かれる(この例では960x640を320x640で三分割)。ただし二人しか出なかったり近づきすぎたりすると混ざるのでControlNetなしだと回数が必要。

男もすなるAI画像といふものを、女もしてみむとてするなり。

Stable Diffusionをインスト―ルするものの、

ControlNetを利用して自分の線画に自動彩色することは

メモリが足らずいとかなし。

でもプロンプトを書き込んで画像を作成するくらいはできたのでいとをかし。 #AIイラスト

@nocky_curren_ ControlNet とか使わなくても、プロンプトだけでも、エモい屋上っぽい画像出ますね。

まずイラスト系モデル。

#AI

①適当に線画を描きます(1枚目)

②適当にバケツ塗ります(2枚目)

③①をcontrolnetのCanyにぶちこみ、②をi2iにぶち込んだ結果(条件はALT)

④をグレスケして(色合いが違う為)②の色を適当に弄って④にオーバーレイ

これ④の工程が雑だからアレだけど、グリザイユ式でアニメ塗りできるな!!!

wildcardを使わなくてもガチャ気分。いえーい。

【controlnet沼からは逃げられない】......λ..........【ボーンでポーズ指定するの大変じゃないですか?】

#AIArt

Sometimes the most interesting results are obtained accidentally.

#AiArt #DigitalArt #AiAnimations #StableDiffusion #Controlnet #Defforum

髪型も衣装もシンプルな方が安定するよね

#StableDiffusion #ControlNet #AIイラスト #ebsynth_utility #TDPT

拡張機能とかControlnetとかアップスケーラーとか弄って召喚した素体

難産だったけどこの程度なら普通にt2iするだけで召喚できたりするw

明日はCannyをクリスタで弄ってグラスさんに寄せていきます

前に綺麗な血の海になったのを、controlNETで線画に脱色して色を付けなおす方法を数回。

構図は死んでるままだけど、雰囲気が真逆なの面白い。昼間と夕暮れみたいな感じ。そして肌ボリュームの差

描きかけで1ヶ月ほど放置してる絵。

Colab環境に構築したAIを、ControlNetというモデルで機能拡張して着色を試みる。

うーむ。

線画はそのままに着色してくれる、ってな風にはなかなかならないのね😹

Ladies! (Auto1111 + ControlNet + Upscale) - by Bra2ha #AiArt #AiiA #AiArtCommunity #AiArtSociety #AiLust

さぁやってまいりました第一回

「AIに書き直させたらどれが一番かっけー」選手権

今回はControlNetという

画像→線画→再着色ができるAIの機能を使って

私が作り出したオリジナルドラゴンメイドの武器をAIに考えてもらおうという企画です

使う元絵はこちら

さぁこの黒棒はどうなるでしょうか!?