controlnetのTwitterイラスト検索結果。 1,175 件中 3ページ目

元BingImageCreatorのCopilotで描いてもらった女剣士。 普通に剣持ってくれるしクオリティ高いから、ここで剣持たせてStablediffusionのControlNetで画風変えるか。 みんな似たようなことしてそうだな。

Control-LoRA(1枚目)

https://t.co/OecAzs975Z

diffusers/controlnet-canny-sdxl-1.0(2枚目)

https://t.co/nVtTN2Vntl

controllllite_v01032064e_sdxl_canny_anime(3枚目)

https://t.co/UT6gCC8uAd

のような結果になった

今私が苦しんでいるのは「線画→ノーマルマップControlNet」学習において、「彫像っぽい絵柄」も一緒に学習してしまい、キャラクターの顔が彫像っぽくなってしまうという罠でして

ふと気づいたんだが、彫像を元にした線画→疑似3D画像ControlNet、わざわざ作らずともこの二枚をコピー機学習法で差分マージして、それ+cannyでなんとか対処できないか検討するところから始めればよかったな。

CN学習なんてでけぇ学習させるより、まずはコンパクトにコピー機学習法ありだた https://t.co/2iz0Jk8B94

現状、pytorch-CycleGAN-and-pix2pixも万能ではなく、SDXL+自作ControlNetの方が優秀ととれる場面もあった

一枚目が自作ControlNet、二枚目がpytorch-CycleGAN-and-pix2pix

これは線画から疑似3D画像に変換するタスク

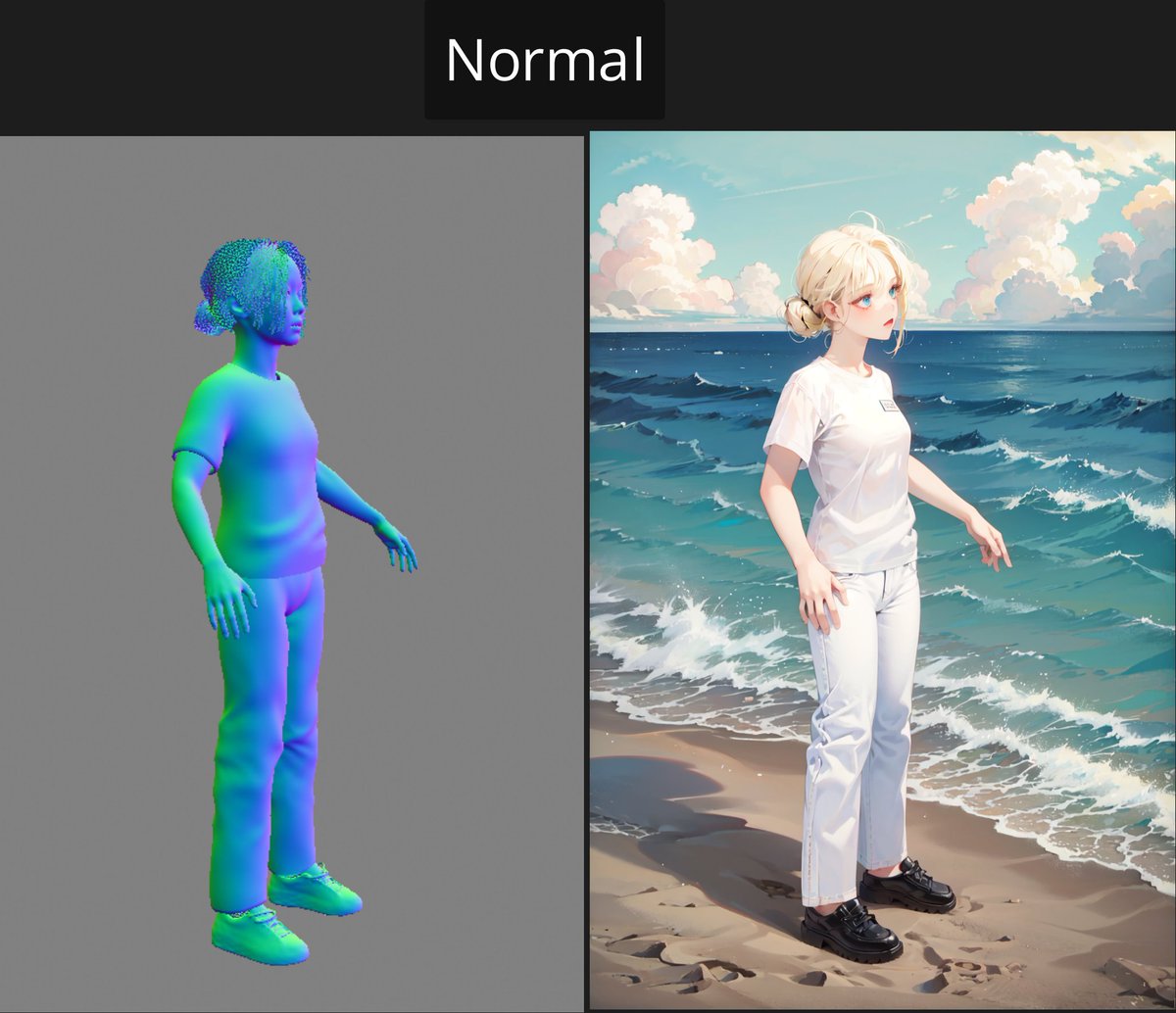

ControlNet用のデータセットを改善したら露骨に結果がよくなったな

1枚目:Line2Normalmap(データセット改修前)5000epoch

2枚目:Canny2Normalmap(データセット改修後)5000epoch

目視によるデータセットチェックって大事かも(cannyにしたのが影響大きいかもだけど

うおおおお!!!!

pix2pix(50epoch)微妙だった!!!!!

生成AI(ControlNet)の方が多分良い!!!!!

試してみないとわかんないものだな・・・!!!

話題のSDWebUI-Forgeを導入して生成してみた

controlnetは最初から入ってるし、adetailerやlama cleanerも使えて生成も早くなっているのでこれは有りかも🤔

ただLoRAのフォルダ分けが出来ない。。。?

#AIイラスト

stable-diffusion-webui\extensions\sd-webui-controlnet\models

(https://t.co/OecAzs975Z)

⑤ControlNetの設定

Enable、Pixel Perfect、Upload independent control imageにチェックをいれて線画を配置

⑥PromptでLoRAを指定してGenerateで生成です。

Navia from Genshin.

This is just a sketch into controlnet. Will make a proper illustration soon.

WebUIのControlnetにInstantID機能が付いたので試してみた。顔写真1枚があれば同一人物として生成出来るのはすごい。ただ予想通りイラスト系の顔ではダメ。ゲームやサービスで同一人物で色々生成したい場合とかに便利かも。画像はAnimagineXLでの出力 #StableDiffusion

https://t.co/Z00JhTrpsZ