controlnetのTwitterイラスト検索結果。 1,175 件中 30ページ目

Me as a father: "Kiddo, smartphones make you impatient & crave instant gratification!"

Me as an AI devotee: "No breakthrough in AI image generation for two days?"

#AIArtCommuity #composer #ControlNet https://t.co/hdTylggUOX

#controlnet のguidance strengthを0.5にしたらcannyでもまともに出力できるようになった。これで背景の生成も安定してよろしくできるようになった。呪文の研究が足りてない。 #stablediffusion #counterfeit

ControlNetを用いてのt2i出力⇒加筆誘導テスト。領域拡張した部分(上と右)、空は境界をぼかしてますが木の部分はそのままにしています(ぼかすと木と空の境目が全体でぼけ始めたので) #WaifuDiffusion #AIイラスト

ControlNetのテスト2。少し構図が違うのが気になるが足の向きとか顔の向きとかはあってる。線画から生成するほうでラフから生成して上書きとかすると時短になりそ。

generated some #glitchart for the img2img source, using the previous post / portrait as a scribble control model.

#aiart #aiartcommunity #stablediffusion #controlnet

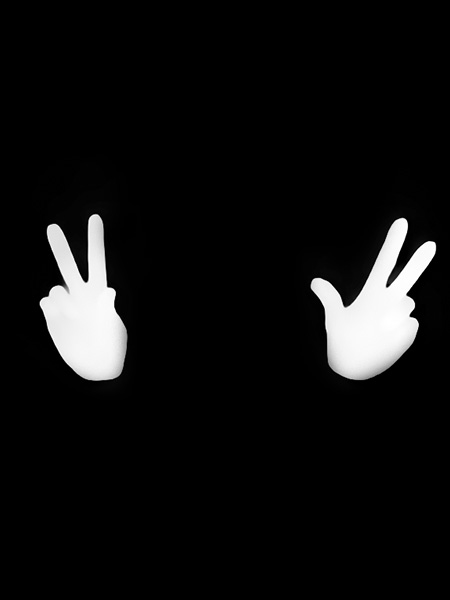

尝试用 #StableDiffusion 还原名场面,txt2img + 用 #ControlNet 控制 pose。不知道大家能不能认出原来的场景 https://t.co/ASTXX5xP8W

ところでさっきからControlNetを使って、フェリオスのアルテミスみたいな絵を出そうとしているのだが、どうやっても魔法少女京町セイカにしかならんw

@VGDCMario This is a result without AddNet and embeddings. 2nd image is a line-art image with ControlNet from 1st image.

#StableDiffusion + #Dreambooth with #ControlNet is insane, absolute control over poses with my face. :) The last pic is the original reference.

#ai #aiart #midjourney #aiartcommunity #generativeart

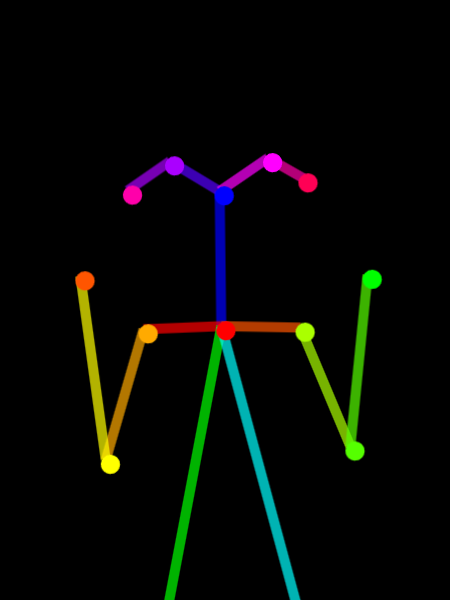

Stable Diffusionのエクステンション、ControlNetを使用したポージング指定書き出しテスト

出力結果、ヨシッ!

Models

・anything-v3.0

https://t.co/cA3LUoWfO0

・canny(for ControlNet)

https://t.co/4UHMhhm4DX

my #ghosted embedding does mostly black and white generations... it's limited, but always interesting.

with #controlnet i'm able to add color + fx to them without changing the original form too much, which is pretty wild.

#aiart #aiartcommunity #stablediffusion