EpochのTwitterイラスト検索結果。 1,526 件

#Paleonusantara day 26: Sphyraena crassidens

Sphyraena crassidens is a species of barracuda from Miocene to Pliocene epoch. Its fossils was found in Indonesia, from Sulawesi to Java. Judging from its teeth, it's about as big as pickhandle barracuda (120-150cm).

#paleoart

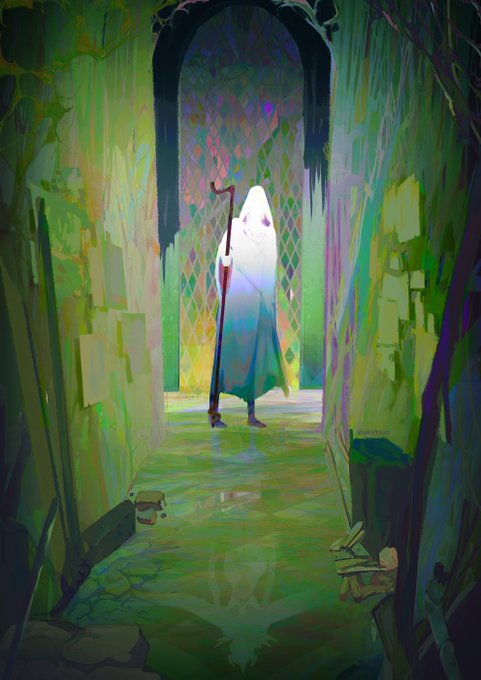

summoning // illustration i contributed to Gallery IYN's (@artandselection) exhibition, "Sensational Epoch"! a print of the piece is on display/sale at their gallery in Osaka, from july 10th to 13th!

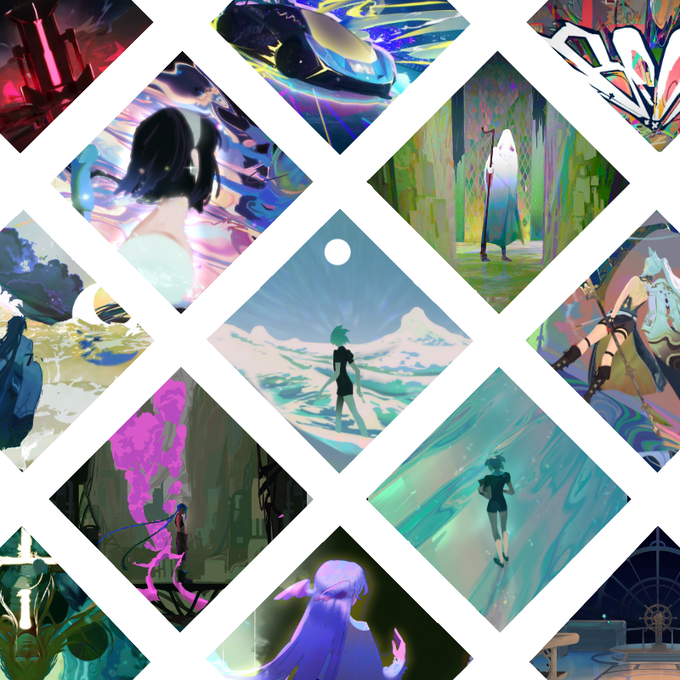

My name's Skirt, I work in animation and video games by providing ethereal backgrounds/color for amazing projects! I am available for new short and long-term projects from July 2025! Clients : Hoyo, Bluepoch, Mooncube Games

kidofrillyskirt/gmail.com

#PortfolioDay

超人力霸王高斯:紀元型態

ウルトラマンコスモス:エポックモード

Ultraman Cosmos:EPOCH MODE

南国育ちのシュリちゃん好きすぎて

ダメもとで4枚の画像だけで学習させて見た結果・・・

大成功ヽ(゚∀゚)ノ

しかも素材が4枚だけなので

学習も5分で終わった優れモノ

epoch6でした。

now i need a jessica psychube to pair with her (c'mon bluepoch, don't be shy and give us jessica's anecdote)

Epochal Spectrum

#HonkaiStarRail #danhengil #ImbibitorLunae

(続き)上記の条件で学習したCNを使って、小さくしたイラストをi2iするとぼやけていた画像がくっきりする

ひとまず3万epochだけどまぁまぁうまくいったな・・・(色合い変わるのがヤだ

もうちょい学習してみるか