233 件中 121〜130件を表示

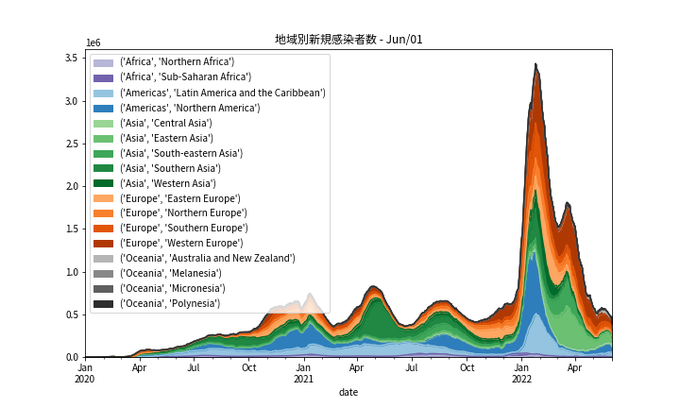

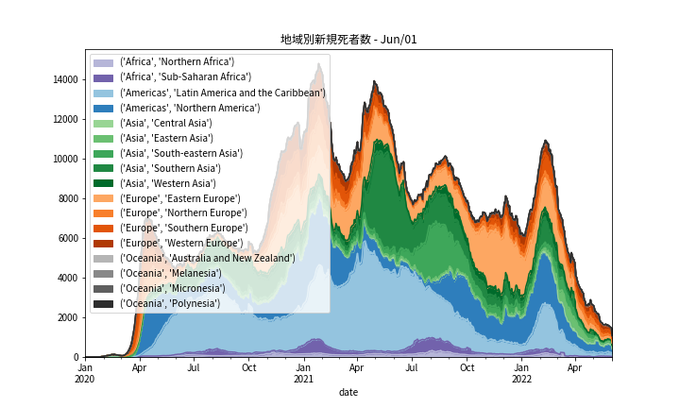

世界的にオミクロン株は収まってきたし、死者数も流行後初めてくらいに減ってきているし、世界で同時的に減ってきているので次のフェーズに移っていきそうだね…

0

0

JINS MEMEで取得したセンサ値からgimpたんを動かしてみる。なにかyawがpitchに絡めて取られることがあっておかしいのと、まばたきを全く検知してくれないのが辛い。

0

3

ASMRとか特定用途なら簡単にモデルを作ってしまえばいいんだよ…という感じで、どのくらいで作れるか試してみる。

…絵を描いた後で1−2時間と言ったところか…

もっとガチ恋距離とかにしたら割とインパクト出るのでは…?

あのマイクで録音しているときにカメラで口元取れるのか知らんけど…

0

3

@LunaFoxgirlVT looks smoother by using dampen with speed=4.

it seems difficult for machine learning model to detect wink though.

0

0

OpenSeeFaceを使って、全Linux、全OSSで完結してできたgimpたん。VTubeStudioとかと比べて反応は速いんだけど、口を開けても反応しなかったりと、顔の変化に対する反応がイマイチ…(OpenSeeFaceのAIモデルの精度の問題だと思う…)

2

6