I2IのTwitterイラスト検索結果。 2,294 件中 2ページ目

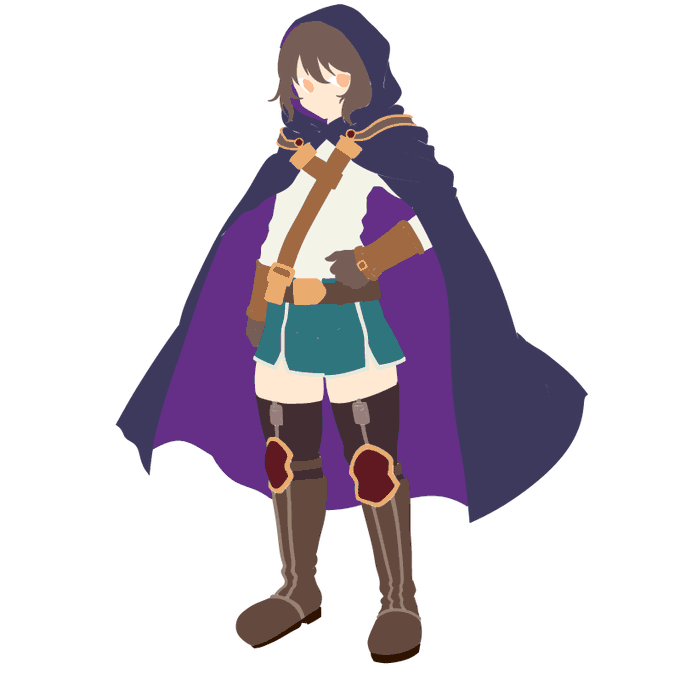

こちらのイラストは虹ジャーニーで出力したものを、SDXLでi2i、高画質したものです。

虹ジャーニーの画風はそのまま顔の造形を変えることが出来るのでおすすめの手法です!

実写系に近づけようかと思って、実写系モデルを探してみたりi2iしてみたりしたけど、

シンプルにchatGPTに聞いたリアル系呪文を冒頭に適当に強調して、ぶち込むだけでいいような気がしてきました(よかったらどうぞ)😇💕

A realistic photo of a serene mountain landscape with a clear blue lake… https://t.co/6fmn4cEvbJ

お絵描き補助AIアプリ『AI-AssistantV3』公開!|とりにく @tori29umai #note https://t.co/q3p2k7NJRz

V3で色見本機能を追加しました!線画を入力してprompt(呪文)で指示すると色見本を出力してくれます!

またanytest対応したおかげで、i2iの使い勝手が格段にアップしました!

@kohya_tech スタイル変換i2i用LoRAのレシピですが自分はこんな感じでやっています(月須和神産

コピー機する場合、バッチ数を上げすぎると飽和する?というのが月須和さんの説だそうです(私には理屈がわからないです!

CN-anytest_v3-50000_am_dim256と併用して使います

極力色合い変えずにAIに書き込みさせるLoRA公開しました!!!

https://t.co/u91nYmBw5P

i2iでデノイズ0.45-0.5。

CN-anytest_v3-50000_am_dim256 [dbecc0f9]:1.0

Katarag_lineartXL-fp16 [ac23a680]:0.25

バケツ塗り絵をi2iに。線画をCN二つにぶち込む感じです。

cloneはi2iでの動作を想定していますが、t2iのCNで動作させた場合、形状を維持しながら様々ないい感じの色合いにランダムで変化させる、という挙動をします。

xl controlnet clone (元画像を維持しつつ拡大できるSDXLのCN 制作途中)

1枚目 入力画像

2枚目 通常i2iで2倍出力(denoise1)

3枚目 同パラメータでcloneで2倍出力(denoise1)

4枚目 原寸との描画比較

xl controlnet clone (元画像を維持しつつ拡大できるSDXLのCN 制作途中)

1枚目 入力画像

2枚目 通常i2iで2倍出力(denoise0.75)

3枚目 同パラメータでcloneで2倍出力(denoise0.75)

4枚目 顔の描画比較

comfyUIでノイズ法 https://t.co/fneuq0qNRF

のi2iを試したけどさすがにcomfyUIでノイズ法は無理かなと思ってたらまあまあ可愛い絵が出てきて満足はしている

コル音イムかわいい コル音イム無限にかわいい

LoRAとcontrolnetによる書き込み量増やしi2iのワークフロー

comfyUI初めて三日目でここまで出来たの凄くないですか???(クソポジティブととと)