Pix2PixのTwitterイラスト検索結果。 52 件中 2ページ目

Instruct Pix2Pixはパラメータに超敏感っぽい

普通の画像生成の感覚でやるとなんもわからん...ってなる

一枚目: オリジナル

二枚目: step 10, image cfg 1.3

三枚目: step 50, image cfg 1.3

四枚目: step 10, image cfg 2

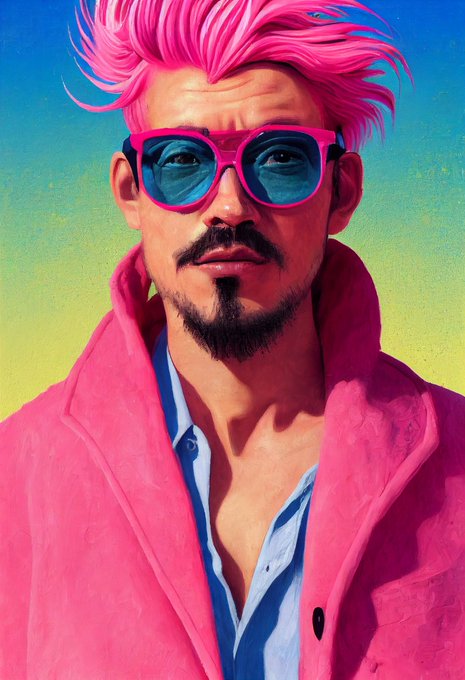

先走ってInstruct Pix2Pix試してみたけど、ヤーバいよこれは。まず1枚目の画像、いい感じだけど昼じゃなくて夜にしたいな~。「Change the background to a night scene」のプロンプトで普通のInP2Pモデルでやったのが2枚目。アニメ系モデルをInP2P変換して試したのが3枚目。仕上げにi2iしたのが4枚目

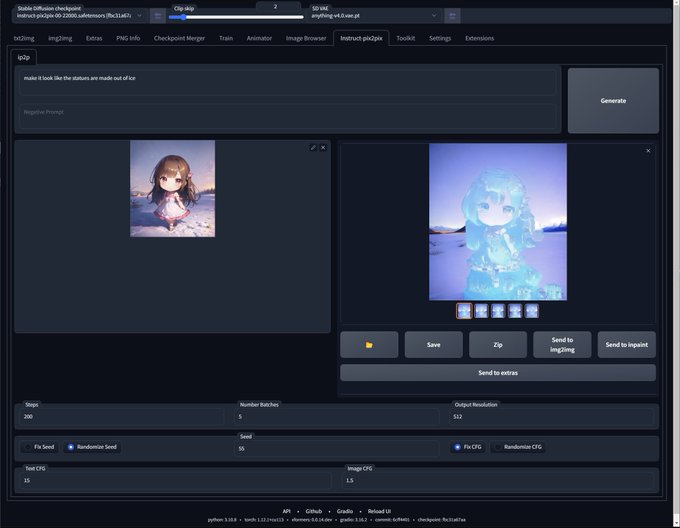

instruct-pix2pixテストで原画→氷化。

なかなか難しいし面白い案が思い浮かばないw

#stablediffusion #instruct_pix2pix

Instruct-pix2pix試した

Imagicは15分程度の学習を必要としたが、こっちの手法ではzero-shotでの画像編集ができる

https://t.co/CV3PQZAD7L

昔の絵をtrinartのpix2pixを利用してリファインできないか検証しました。修正は必要ですが、かなり行けそうです。 https://t.co/6D0Hvoi7MY

✅塗り絵の自動着色(人工知能)

を3度目のトライ( ゚Д゚)

現在、順調に着色できてる模様😆

5万枚のイラストを入手したのでpix2pixでAIを学習してるけど、現在、37500step。epochはまだ1です。

epochが100になるのは明日の朝か昼ぐらいかな。

✅pix2pix - 敵対的生成ネットワーク(GAN)

TensorFlowでpix2pixをやってみたけど、データ収集(100枚)からAI学習まで2時間ぐらいで「塗り絵」を「AIで自動着色」できる( ゚Д゚)

今回の元データは適当なので、

吟味すれば塗り絵の精度は確実に高くなります😆

次は白黒写真のカラー化をやってみます

생성적 적대 신경망(GAN)의 한 종류인 Pix2Pix모델을 이용하여 포켓몬 선화 이미지를 넣으면 채색해주는 간단한 서비스를 만들어보았습니다. 처음 만들어보는 서비스라 여기저기 부족한 곳이 많지만 테스트 한번 해보시고 피드백 주시면 감사하겠습니다!

https://t.co/e3nRb2dTvU

thanks to @bungula1 and their hard working building a dataset, i was able to train pix2pix to add Garfield back into Garfield Minus Garfield

or at least, attempt to

#iOSDC

「iOS端末でGANを利用して画像を生成する」

Pix2Pix等で入力が線画の場合、iOS実行時にCIFilterやMetal のエッジフィルターを使えますが、トレーニング画像に合わせた方が、より近い出力が得られます。

トレーニングデータがopenCVで作られている場合、iOS版のOpenCVを入れるのも一つの手です

Training what is turning out to be a Garfield colorization model w. pix2pix.

At this point it's colorizing every single non-Garfield character like Jon Arbuckle.