controlNetのTwitterイラスト検索結果。 1,177 件中 2ページ目

結論から言うとやっぱりControlnetで色の制御はできないっぽいですね!!!!

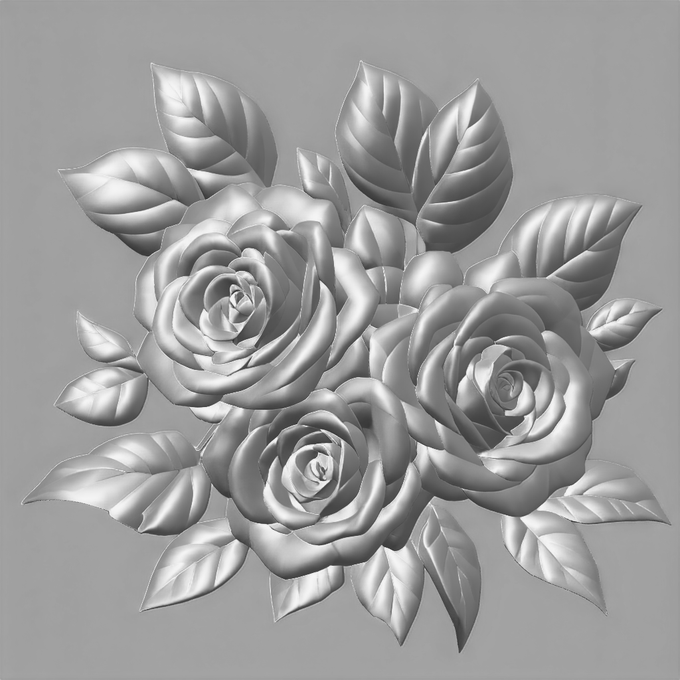

かたらぎさんに依頼していたブラーCNですが、グレスケ入力してもカラー入力しても、ほぼ同じ結果になりました!

むしろグレスケの方がなんかいい感じかも、なぜだ・・・・!!!

かたらぎ(@redraw_0 )様にご協力いただいて、ブラーControlnet学習しました!

1枚目が2枚目になります。色合いは変わるけどすごいもの作れちゃった気がする・・・!!!

これ高解像度化に使えないかな

https://t.co/MVmJfYgWV2

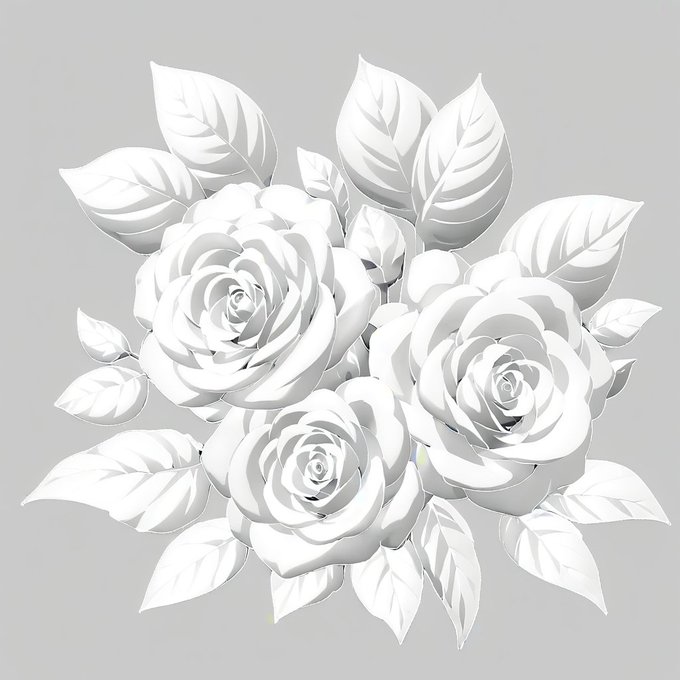

あとControlNet 852_a_clone_xlは陰影を保ったまま、モノクロのスタイル変換ができる!!LoRAで陰影使い分け可能!!

理屈はわからんけどなんかできる!!!!

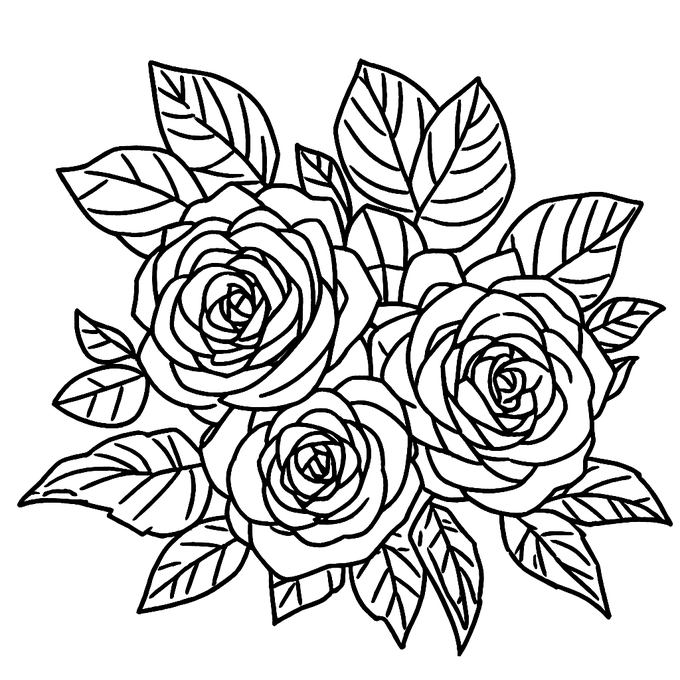

852話さんのControlNet 852_a_scribble_xlのすごいところはね。 マウスで描いたり、生成の過程で生まれた太かったり平坦な線を『なんかいい感じ』にしてくれるところだよ

1枚目:元絵

2枚目:従来の手法

3枚目:ControlNet 852_a_scribble_xl

理屈はわからんが「なんかいい感じ謎補正力」が高い

SDXLの画風LoRA詳しい人助けてください!

線画から陰影を出力するContorlNetを作るべく手動で作業していたのですが、あまりにも時間がかかるので諦めました。

ので陰影LoRAを作り、それから線画抽出することでControlNetが作れないか検討しています(続く

「入力された線画をそのまま出力する」ControlNetを作ってみました。

何か意味あるの?と言いたくなるモデルですが、LineartやLine2Normalmapなどと併用することで、入力された線に対する忠実度の向上が期待できます

(サンプルの青線画元の入力線画)

https://t.co/57AtHjEXDW

xl controlnet clone (元画像を維持しつつ拡大できるSDXLのCN 制作途中)

1枚目 入力画像

2枚目 通常i2iで2倍出力(denoise1)

3枚目 同パラメータでcloneで2倍出力(denoise1)

4枚目 原寸との描画比較

xl controlnet clone (元画像を維持しつつ拡大できるSDXLのCN 制作途中)

1枚目 入力画像

2枚目 通常i2iで2倍出力(denoise0.75)

3枚目 同パラメータでcloneで2倍出力(denoise0.75)

4枚目 顔の描画比較

Plat(@p1atdev_art)さんのdart-v2でランダム生成したpromptをkohya(@kohya_tech)さんに15000枚ランダムで生成していただきました!

こちらでこんな感じのControlNet用を学習してみようと思います!!!flatlineとでもしましょう!

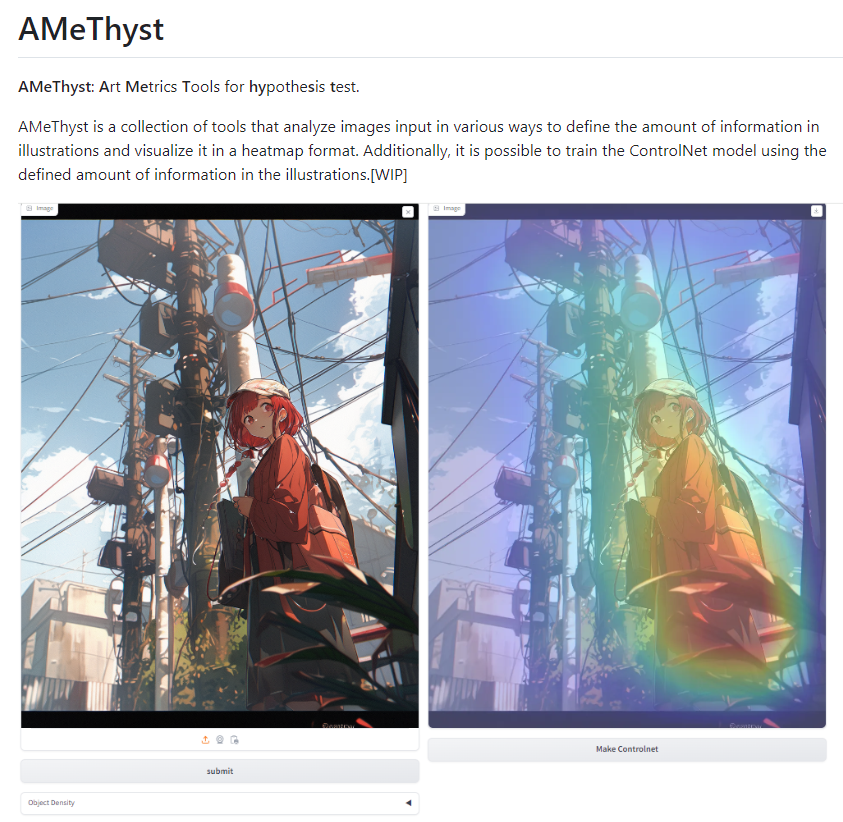

画像生成時に描写される物体の密集度を制御するControlNetを作ってみました

結構改善の余地がありそうですが、一応SDXL用の試作版モデルをHugging Faceにあげたので興味がある人は是非

なんとかしてAIイラストの情報量制御に辿り着きたい気持ち

https://t.co/uqzNog8T9r

852_a_scribble_xl_256.safetensors

https://t.co/IILgzrJrMb

civitaiで配布。

normalとhardとveryhardのバージョンがあります。

このcontrolnetはアニメ調の学習をしたSDXL系列のscribbleモデルです。 落書きを描き上げたり、絵や写真の形状を維持しながら再生成するのに特化しています。

LoRAとcontrolnetによる書き込み量増やしi2iのワークフロー

comfyUI初めて三日目でここまで出来たの凄くないですか???(クソポジティブととと)

Katarag_lineartXすごい!!!

1枚目:Kataragi_lineartXL-lora128 [0598262f]

2枚目:control-lora-canny-rank256 [ec2dbbe4]

control-lora-canny-rank256を超えるこの手のControlNetがでてきたー!!!!!

https://t.co/blMNbjpj4v

イラストの情報量を可視化するツールをgithubに上げました!

今は物体の密集度と深度情報による解析ができます

解析方法は組み合わせて使用でき、自分の思う情報量の定義を探れます!

今後は解析方法を増やす&定義した情報量でControlNetを作成できるようになる予定です!

https://t.co/jj31UTCpFK