pix2pixのTwitterイラスト検索結果。 50 件

現状、pytorch-CycleGAN-and-pix2pixも万能ではなく、SDXL+自作ControlNetの方が優秀ととれる場面もあった

一枚目が自作ControlNet、二枚目がpytorch-CycleGAN-and-pix2pix

これは線画から疑似3D画像に変換するタスク

自分で生成したりフォロワーから提供いただいた線画1088枚をから陰影を生成して、それからpix2pixモデルが作れないか実験してみる。

これがうまく言ったら生成AIを使わずに軽めの推論で影がつけれる。

画像は紅茶うさぎ(https://t.co/DeftNAaOUq)さんからご提供いただいた線画をAIで陰影づけたもの

AI詳しい人に質問です・・・!

今自分はこういう、立ち絵の顔+髪をマスクするAIモデルを作りたいと思っています!

こういうタスクが得意なAIってなんでしょうか?

とりあえず自分はデータセットを人力で作って、pix2pixで学習させようかなと思うのですが、他に良いアイディアはないでしょうか?

うおおおお!!!!

pix2pix(50epoch)微妙だった!!!!!

生成AI(ControlNet)の方が多分良い!!!!!

試してみないとわかんないものだな・・・!!!

入力画像を変換するタスクを Diffusion モデルで解く ControlNet についての解説記事を書きました。画像のような線画 -> 着彩のタスク等を解くことができます。

新時代の pix2pix? ControlNet 解説|まっくす https://t.co/IcN6wWHS6y #zenn

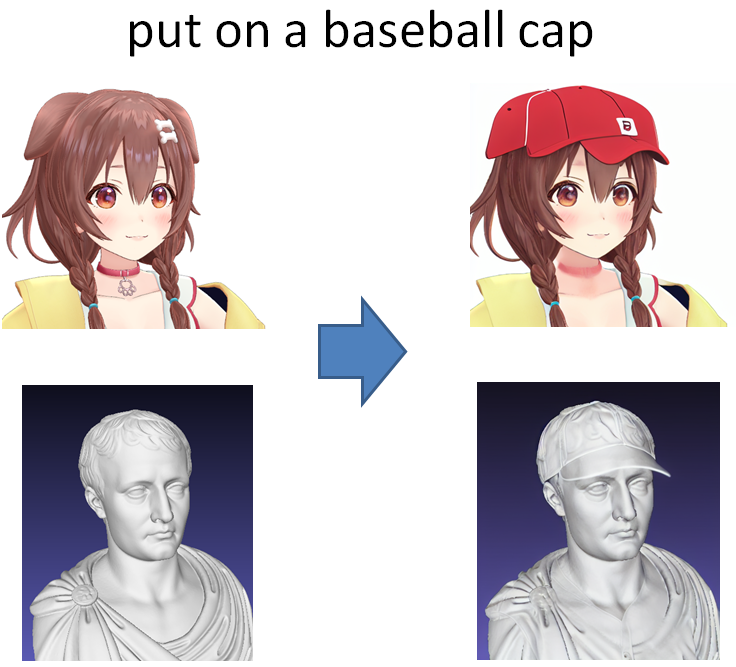

InstructPix2Pix試してみました.凄いですね.

画像毎のパラメータの微調整と,オリジナルの特徴の残し方(上だと耳の形状,下だと髪の毛が帽子に特徴として出ている)が気になりますが,それも時間の問題なのでしょう.

Instruct pix2pix用のDeDeDeのチェックポイントを上げました #DeDeDeArt #AIArt

https://t.co/fxZMHZhEH0

Back to my own #AI Here I did alterations of 4, with more and less #pix2pix emphasis and #prompt emphasis

Then made new pix2pix alterations with alot of emphasis on different directions to take the artwork

Tell me which one is your favorite below..

1, 2, 3 or 4 ?

#AIArtwork

https://t.co/vh9Z2JswXp おもしろい!

チャット形式で入れた画像を指示して変えてける

#InstructPix2Pix 使ってるのねw

SDくんで作った失敗作(上)を変えてみた

画質は悪い(自前の環境でip2p調教しないとだね)

https://t.co/5XSIe4Q9tn

Instruct-Pix2Pix試していますが苦戦中。Sampling methodからDDIMが選べなかったので相性を踏まえ昨年9月頃Euler a出力したSD絵を用いて検証。1枚目を元に「Girls' hairband changed to red」や「Background changed to green」を実施。…当面様子見ですね #WaifuDiffusion #AIイラスト

手始めに、Instruct Pix2Pixでimg2imgできるようにしてみた。

一応期待通りに動いてるみたい。ただ、何に使えるのかは不明。

https://t.co/eb81da93jq

prompt = put a pearl earring on her

一枚目: instruct image

二枚目: init image

三枚目: strength 1.0

四枚目: strength 0.5

Instruct Pix2Pix

プロンプトの基本構文をTurn X into Yと考えたときに、普通はYが重要でXはただの代名詞ではないかと思うが、Xもかなり重要っぽい?

一枚目: 3D人形(私がモデリングした)

二枚目: turn 3d doll into cute anime girl

三枚目: turn her into cute anime girl

四枚目: cute anime girl